PyTorch实现冻结部分参数训练另一部分

在本文中,我们将介绍如何使用PyTorch实现冻结部分参数并训练另一部分。我们将提供两个示例,一个是冻结卷积层参数,另一个是冻结全连接层参数。

示例1:冻结卷积层参数

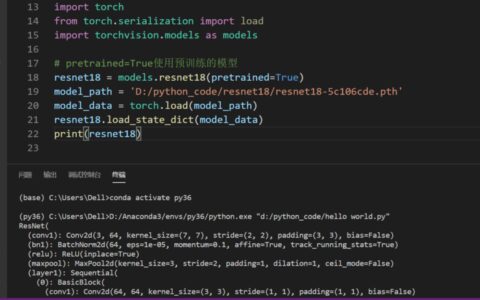

以下是冻结卷积层参数并训练全连接层的示例代码:

import torch

import torch.nn as nn

import torchvision.models as models

# Load pre-trained model

model = models.resnet18(pretrained=True)

# Freeze convolutional layers

for param in model.parameters():

param.requires_grad = False

# Replace last fully connected layer

num_features = model.fc.in_features

model.fc = nn.Linear(num_features, 10)

# Train only the fully connected layer

optimizer = torch.optim.SGD(model.fc.parameters(), lr=0.001)

# Train the model

# ...

在这个示例中,我们首先加载了预训练的ResNet18模型。接下来,我们使用for循环将所有卷积层参数设置为不需要梯度计算,从而冻结这些参数。然后,我们替换了最后一个全连接层,并将其输出大小设置为10。接下来,我们定义了一个优化器,只训练全连接层的参数。最后,我们训练模型。

示例2:冻结全连接层参数

以下是冻结全连接层参数并训练卷积层的示例代码:

import torch

import torch.nn as nn

import torchvision.models as models

# Load pre-trained model

model = models.resnet18(pretrained=True)

# Freeze fully connected layer

for param in model.fc.parameters():

param.requires_grad = False

# Train only the convolutional layers

optimizer = torch.optim.SGD(filter(lambda p: p.requires_grad, model.parameters()), lr=0.001)

# Train the model

# ...

在这个示例中,我们首先加载了预训练的ResNet18模型。接下来,我们使用for循环将全连接层参数设置为不需要梯度计算,从而冻结这些参数。然后,我们定义了一个优化器,只训练卷积层的参数。最后,我们训练模型。

总结

在本文中,我们介绍了如何使用PyTorch实现冻结部分参数并训练另一部分,并提供了两个示例说明。这些技术对于在深度学习模型中进行微调非常有用。

本站文章如无特殊说明,均为本站原创,如若转载,请注明出处:pytorch 实现冻结部分参数训练另一部分 - Python技术站

微信扫一扫

微信扫一扫  支付宝扫一扫

支付宝扫一扫