每年由美国计算机协会(Association of Computing Machinery,简称ACM)计算机图形专业组举办的年会SIGGRAPH,是全球最负盛名的图形学和交互技术盛会。今年已经是这场图形学盛宴的第四十四届,本届大会于7月30日至8月3日在美国洛杉矶举行。

作为著名的好莱坞所在地,洛杉矶聚集了大量影视特效等工业界的从业人员,而SIGGRAPH正是工业界展示自己炫酷技术,以及和学术界交流的一个绝佳平台,所以SIGGRAPH组委会多次选择洛杉矶作为大会举办地。

除了像其它学术会议一样的学术界论文报告与交流之外,SIGGRAPH大会上各种应接不暇的新鲜技术展示、工业界各大公司五花八门的展览会、以及艺术家们展现自己最新创作成果的动画汇演都吸引着无数参会者的目光。SIGGRAPH会场的热闹程度堪比各种大型的博览会。

深度学习邂逅图形学

本届大会上,令我印象最深刻的是会议第一天的主旨演讲环节,大会邀请到了迪士尼第一位非洲裔动画师Floyd Norman,以谈话的形式,讲述了他如何走上这条道路,以及自身成长的故事。Floyd还分享了自己对动画这一领域的独到见解。这场主旨演讲除了在会场最大的报告厅进行外,会展厅的入口大厅处也摆放了现场直播的大屏幕,而在大屏幕前,很多志愿者、参观者、学术界的教授席地而坐,专心聆听动画大师的分享。

在这样一个图形学盛会上自然少不了学术界的最新研究成果。对于图形学领域的研究者来说,SIGGRAPH无疑是一个最顶级的发表和交流自己学术成果的舞台,能够在SIGGRAPH上发表论文,就意味着自己的研究成果得到了国际同行的最大肯定。

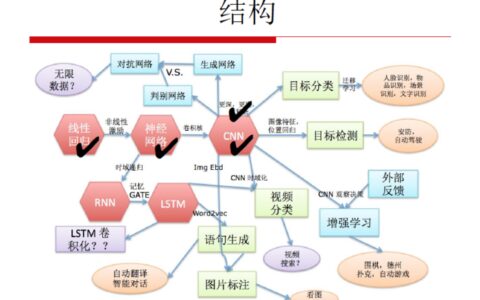

今年学术报告一个很大的趋势便是深度学习技术在图形学领域开始生根发芽,有很多的论文试图探索利用深度学习技术解决传统的图形学问题——在真实感渲染、表观建模、几何建模与分析等领域都有一些不错的尝试。除了论文的口头报告,在SIGGRAPH大会举办的众多讲座和课程上,我们也能看到许多与深度学习相关的话题。由此可见,如何更加有效地将深度学习与计算机图形学相结合,在近一段时间内仍然将成为图形学学术研究的一大热点。

本次大会上,微软亚洲研究院共有四篇论文被接收。在这些研究中,我们对于如何利用深度学习技术求解图形学领域的待解难题,也进行了新颖的尝试。

其中,我有幸与微软亚洲研究院的研究员们一起,在表观建模方向上结合深度学习技术进行了一些探索。“Modeling Surface Appearance from a Single Photograph using Self-Augmented Convolutional Neural Networks”就是我们发表于今年大会的论文。

材质的表观精确地刻画了给定材质表面的纹理颜色,以及它的反射、折射等属性,这是对物体进行真实化渲染的重要参数,也是数字化重建的重要步骤之一。在这篇论文中,我们首次尝试利用深度学习技术,仅通过一张未知光照条件下拍摄的平面材质照片,就可以恢复出该材质的表观纹理模型。

这其中最大的难点在于监督数据的严重缺乏。对于表观建模而言,监督数据意味着一张给定的照片及它对应的表观纹理参数。而表观纹理参数的获得目前还是一个很复杂的过程,需要复杂的采集设备和长时间的采集,或是艺术家复杂的交互建模。为了解决这个问题,我们提出了一种全新的自增强神经网络的训练方法,这种方法把真实感渲染这一表观建模的逆映射引入到了训练流程中,使得我们可以使用大量的无标注数据,即平面纹理材质的照片,结合少量的标注数据一起对网络进行训练,从而得到和艺术家人工标注结果相近的表观预测结果。

此外,微软亚洲研究院也在本次大会上介绍了其他的图形学最新研究成果,包括基于八叉树的深度卷积神经网络,可有效的将传统面向图像的卷积神经网络推广到三维空间中;基于深度图像类比的风格转换,可以实现具有语义属性的图像风格迁移;以及交互式的草图建模,可实现对自由曲面的快速造型等。

精彩纷呈的技术展示

在学术报告之外,来自工业界和部分高校的新兴技术展示也吸引了参会者的眼球。今年的各大厂商展台上,虚拟现实(VR)及增强现实(AR)技术成为了一个非常重要的主题,各大厂商各显神通,展示了自己的最新技术成果,炫酷的体验让人大开眼界。

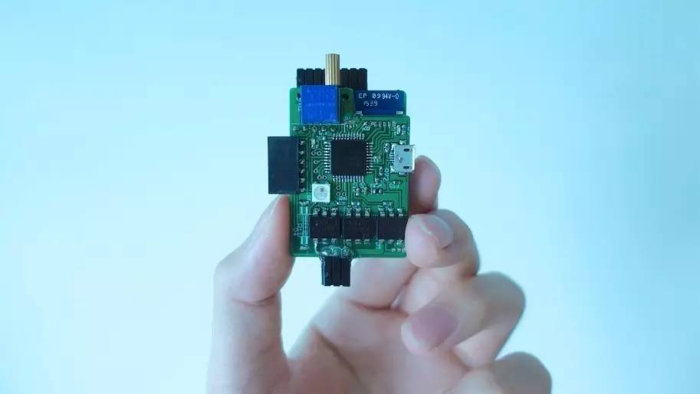

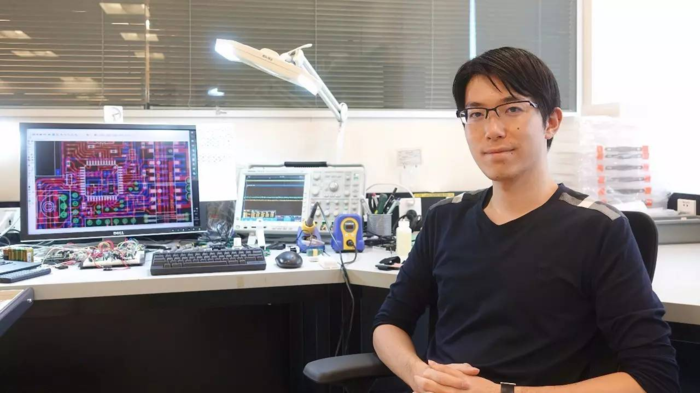

在大会的Etech(Emerging Technologies)环节,来自日本筑波大学的微软亚洲研究院实习生西田惇做了“Wired Muscle: Generating Faster Kinesthetic Reaction by Interpersonally Connecting Muscles”的demo展示,他与索尼计算机科学实验室进行合作,通过使用配对的可穿戴设备引入一种新的运动学习形式,能够基于生物信号测量和肌肉电刺激来分享两个人之间的肌肉活动。这套可穿戴的肌肉I/O设备是西田惇在微软亚洲研究院的硬件实验室手工设计和制造的,可以通过在使用者的皮肤上施加刺激电压来测量和控制肌肉活动。跟基于视觉刺激的反应过程相比,通过肌肉刺激,用户可以更快地做出相应的运动动作。从而用于对抗性运动训练以及康复治疗过程。

可穿戴的肌肉I/O设备

该项研究论文已在今年5月份举行的ACM SIGCHI 2017大会上做过口头报告,而在本届SIGGRAPH大会上的展示过程吸引了超过400名来自各个研究机构和公司的体验者,收到了众多有价值的用户反馈和实验数据。

参加学术会议,除了听取世界各地学术研究者的精彩报告之外,和大家进行交流也是必不可少的一个环节。按照惯例,SIGGRAPH会议期间,大会举办了盛大的社交酒会,参加会议的学术界和工业界的从业者们,有机会和不同研究方向的人进行充分的交流分享。

SIGGRAPH就像一个盛大的聚会。正如本届大会的宣传口号“At the heart of Computer Graphics”所说的那样,在这里,学术界和工业界汇聚一堂,新鲜的技术和想法交织出了计算机图形学最绚丽的火花。明年大会将移师加拿大的温哥华举行,期待来年的盛会能继续为我们带来更多新鲜的技术和炫酷的体验。

作者简介

李潇是中国科学技术大学和微软亚洲研究院的联合培养博士生。在微软亚洲研究院跟随童欣研究员和董悦研究员从事计算机图形学相关的研究。目前,他的研究兴趣在于物体的表观建模和重建,希望通过相关的研究,使所有人都能够更容易地在虚拟世界创造和再现真实的物体材质,打破真实世界和虚拟世界的鸿沟。

西田惇是日本筑波大学Cybernics研究中心博士生,曾获得微软亚洲研究院“微软学者”奖学金以及日本文部科学省奖学金。他的研究主要是利用可穿戴设备去延展人的认知和活动能力,并应用到医疗辅助方面。目前他是微软研究院机器人与人机交互组的实习生,研究利用设备和微软产品探索新的人际沟通方式。

相关论文

1. Modeling Surface Appearance from a Single Photograph using Self-augmented Convolutional Neural Networks

http://msraig.info/~sanet/sanet.htm

2. O-CNN: Octree-based Convolutional Neural Networks for 3D Shape Analysis

http://wang-ps.github.io/O-CNN

3. BendSketch: Modeling Freeform Surfaces Through 2D Sketching

http://haopan.github.io/bendsketch.html

4. Visual Attribute Transfer through Deep Image Analogy

https://arxiv.org/abs/1705.01088

5. bioSync: A Paired Wearable Device for Blending Kinesthetic Experience

https://www.researchgate.net/publication/313445073_bioSync_A_Paired_Wearable_Device_for_Blending_Kinesthetic_Experience

6. Wired muscle: generating faster kinesthetic reaction by inter-personally connecting muscles

https://www.researchgate.net/publication/318692672_Wired_muscle_generating_faster_kinesthetic_reaction_by_inter-personally_connecting_muscles

本站文章如无特殊说明,均为本站原创,如若转载,请注明出处:SIGGRAPH 2017:深度学习与计算机图形学的碰撞 - Python技术站

微信扫一扫

微信扫一扫  支付宝扫一扫

支付宝扫一扫