下面是关于“双向RNN:bidirectional_dynamic_rnn()函数的使用详解”的完整攻略。

解决方案

以下是双向RNN:bidirectional_dynamic_rnn()函数的使用详解的详细步骤:

步骤一:双向RNN介绍

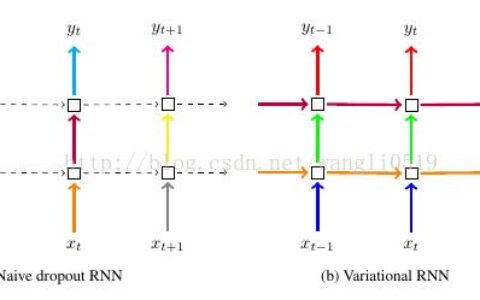

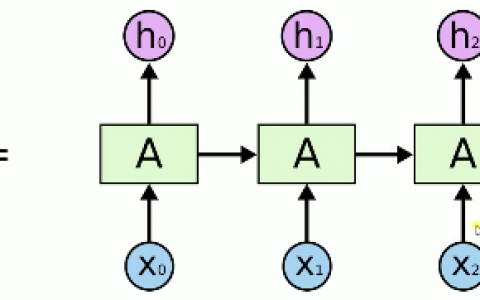

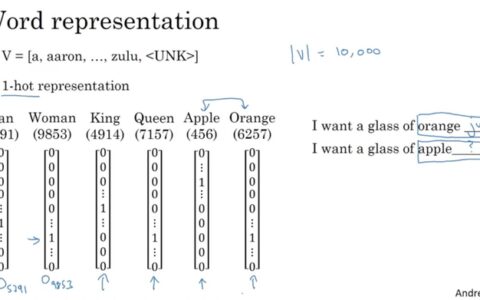

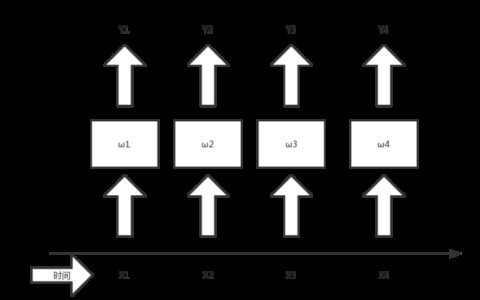

双向RNN是一种常用的循环神经网络模型,它可以同时考虑前向和后向的信息,从而提高模型的准确性和鲁棒性。双向RNN通常由两个单向RNN组成,分别处理正向和反向的输入序列,然后将它们的输出进行拼接或求平均值,得到最终的输出结果。

步骤二:bidirectional_dynamic_rnn()函数介绍

bidirectional_dynamic_rnn()函数是TensorFlow中用于构建双向RNN模型的函数,它可以自动处理输入序列的长度变化,从而提高模型的灵活性和效率。bidirectional_dynamic_rnn()函数的主要参数包括:

-

cell_fw:前向RNN单元。

-

cell_bw:后向RNN单元。

-

inputs:输入序列。

-

sequence_length:输入序列的长度。

-

dtype:数据类型。

-

scope:变量作用域。

以下是使用bidirectional_dynamic_rnn()函数构建双向RNN模型的示例代码:

import tensorflow as tf

# 定义前向RNN单元

cell_fw = tf.nn.rnn_cell.BasicLSTMCell(num_units=hidden_size)

# 定义后向RNN单元

cell_bw = tf.nn.rnn_cell.BasicLSTMCell(num_units=hidden_size)

# 定义输入序列

inputs = tf.placeholder(dtype=tf.float32, shape=[batch_size, max_time, input_size])

# 定义输入序列的长度

sequence_length = tf.placeholder(dtype=tf.int32, shape=[batch_size])

# 定义双向RNN模型

outputs, states = tf.nn.bidirectional_dynamic_rnn(cell_fw=cell_fw, cell_bw=cell_bw, inputs=inputs, sequence_length=sequence_length, dtype=tf.float32)

# 将前向和后向的输出进行拼接

outputs_concat = tf.concat(outputs, axis=2)

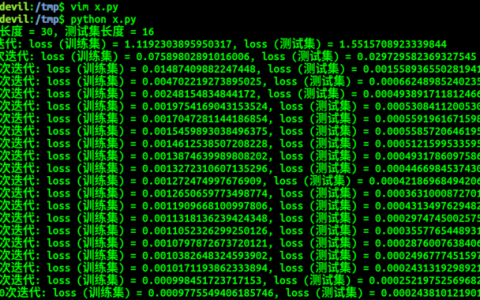

步骤三:使用双向RNN进行情感分析

以下是使用双向RNN进行情感分析的示例代码:

import tensorflow as tf

# 定义前向RNN单元

cell_fw = tf.nn.rnn_cell.BasicLSTMCell(num_units=hidden_size)

# 定义后向RNN单元

cell_bw = tf.nn.rnn_cell.BasicLSTMCell(num_units=hidden_size)

# 定义输入序列

inputs = tf.placeholder(dtype=tf.float32, shape=[batch_size, max_time, input_size])

# 定义输入序列的长度

sequence_length = tf.placeholder(dtype=tf.int32, shape=[batch_size])

# 定义双向RNN模型

outputs, states = tf.nn.bidirectional_dynamic_rnn(cell_fw=cell_fw, cell_bw=cell_bw, inputs=inputs, sequence_length=sequence_length, dtype=tf.float32)

# 将前向和后向的输出进行拼接

outputs_concat = tf.concat(outputs, axis=2)

# 定义全连接层

W = tf.Variable(tf.truncated_normal([2 * hidden_size, num_classes], stddev=0.1))

b = tf.Variable(tf.constant(0.1, shape=[num_classes]))

logits = tf.matmul(outputs_concat, W) + b

# 定义损失函数

cross_entropy = tf.nn.softmax_cross_entropy_with_logits(logits=logits, labels=labels)

loss = tf.reduce_mean(cross_entropy)

# 定义优化器

optimizer = tf.train.AdamOptimizer(learning_rate=learning_rate).minimize(loss)

# 定义准确率

correct_predictions = tf.equal(tf.argmax(logits, 1), tf.argmax(labels, 1))

accuracy = tf.reduce_mean(tf.cast(correct_predictions, tf.float32))

结论

在本文中,我们详细介绍了双向RNN:bidirectional_dynamic_rnn()函数的使用详解的过程。我们提供了两个示例说明可以根据具体的需求进行学习和实践。需要注意的是,应该确保代码的实现符合标准的流程,以便于获得更好的结果。

本站文章如无特殊说明,均为本站原创,如若转载,请注明出处:双向RNN:bidirectional_dynamic_rnn()函数的使用详解 - Python技术站

微信扫一扫

微信扫一扫  支付宝扫一扫

支付宝扫一扫