关于PyTorch自动求导机制详解

在PyTorch中,自动求导机制是深度学习中非常重要的一部分。它允许我们自动计算梯度,从而使我们能够更轻松地训练神经网络。在本文中,我们将详细介绍PyTorch的自动求导机制,并提供两个示例说明。

示例1:使用PyTorch自动求导机制计算梯度

以下是一个使用PyTorch自动求导机制计算梯度的示例代码:

import torch

# Create tensor with requires_grad=True

x = torch.tensor([2.0], requires_grad=True)

# Define function

y = x ** 2 + 2 * x + 1

# Compute gradients

y.backward()

# Print gradients

print(x.grad)

在这个示例中,我们首先创建了一个张量,并将requires_grad设置为True,以便PyTorch跟踪它的梯度。然后,我们定义了一个函数,并使用该张量计算了函数的值。接下来,我们使用backward函数计算梯度,并打印了张量的梯度。

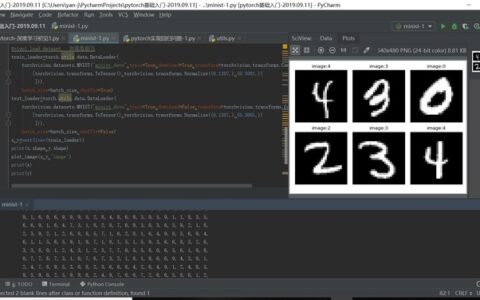

示例2:使用PyTorch自动求导机制训练神经网络

以下是一个使用PyTorch自动求导机制训练神经网络的示例代码:

import torch

import torch.nn as nn

import torch.optim as optim

# Define neural network

class Net(nn.Module):

def __init__(self):

super(Net, self).__init__()

self.fc1 = nn.Linear(1, 10)

self.fc2 = nn.Linear(10, 1)

def forward(self, x):

x = torch.relu(self.fc1(x))

x = self.fc2(x)

return x

# Create neural network

net = Net()

# Define loss function and optimizer

criterion = nn.MSELoss()

optimizer = optim.SGD(net.parameters(), lr=0.01)

# Train neural network

for epoch in range(100):

optimizer.zero_grad()

output = net(torch.tensor([[1.0]]))

loss = criterion(output, torch.tensor([[4.0]]))

loss.backward()

optimizer.step()

# Test neural network

output = net(torch.tensor([[1.0]]))

print(output)

在这个示例中,我们首先定义了一个简单的神经网络,并定义了损失函数和优化器。然后,我们使用自动求导机制训练了神经网络,并测试了它的输出。

总结

在本文中,我们详细介绍了PyTorch的自动求导机制,并提供了两个示例说明。这些技术对于在深度学习中进行实验和比较模型性能非常有用。

本站文章如无特殊说明,均为本站原创,如若转载,请注明出处:关于PyTorch 自动求导机制详解 - Python技术站

微信扫一扫

微信扫一扫  支付宝扫一扫

支付宝扫一扫