摘要:现在,越来越多的企业和个人使用AIGC生成文章、图片、音乐甚至视频等内容,AIGC已经成为一种必备的工具。在游戏和原画师行业,甚至已经出现了第一批因为AI而失业的人。

本文分享自华为云社区《GPT-4发布,AIGC时代的多模态还能走多远?系列之二:AIGC的阿克琉斯之踵》,作者:ModelArts 开发 。

AIGC是继PGC(Professional Generated Content,专业生产内容)和UGC(User Generated Content,用户生产内容)之后的一个新时代,它带来了一种新的内容生产方式,并且还为内容注入了只有人类才具备的“创作”元素,开创了“模型”主导内容的时代。尽管AIGC技术已经有了相当大的提升,但仍然存在很多不足之处。

01 ChatGPT(包括GPT4)的诸多问题难以忽视

尽管ChatGPT(包括GPT4)是一个非常有用的工具,但它仍然存在许多问题。以下是一些经常出现的问题:

1) 强语言,弱知识,“一本正经地胡说八道”:在回答问题时,ChatGPT很容易“胡说八道”,因为它的回答通常是基于大量的文本数据而生成的,而不是真正的知识。比如下面的问题:

Q:红楼梦中贾宝玉为什么要葬花?

A:据小说描写,贾宝玉葬花的原因是因为他感到世间美好事物的短暂和凋零…

Q:鲁迅和周树人是同一个人吗?

A:不是同一个人,鲁迅和周树人是两个不同的人。鲁 迅…而周树人(1895年1月25日-1968年11月6日)也是中 国著名的现代作家和翻译家,代表作品有《春蚕》、《子夜》等

2) 逻辑推理不靠谱:不论是数学逻辑还是专业逻辑,比如下面的问题:

Q:3个人3天用3桶水,9个人9天用几桶水?

A:根据题目可知,3个人在三天内用了3桶水,

可以推算出每天每人用水量为:

3 桶 / 3 人 / 3 天 = 1 桶 / 人 / 天

因此,在9个人使用9天内需要的总用水量为:

1 桶 / 人 / 天 × 9 人 × 9 天 = 81 桶

所以,9个人在九天内需要用 81 桶的水。(正确答案27桶)

3) 实时信息自更新慢,新旧知识难以区分,比如下面的问题:

Q:现任韩国总统是谁?

A:现任韩国总统是文在寅 。

Q:gpt4是什么时候发布的?

A:抱歉,目前还没有关于GPT-4的官方发布计划和消息

4) 无法真正为领域类问题提供专业、靠谱的答案,比如下面的问题:

Q:华为手机没电了,请问能否使用苹果手机的充电器充电?

A:可以的,苹果手机和华为手机使用的充电器接口都是标准的USB接口,因此苹果手机的充电器也可以用来给华为手机充电。不过,请注意使用符合标准的充电器。

02 多模态大模型的跨模态生成能力尚不完善

虽然AIGC跨模态生成技术的视觉效果令人惊叹,但在实际应用过程中存在一些信息不对称的问题。目前,多模态大模型在跨模态生成方面仍然存在一些不完善之处,需要进一步研究和优化。从文本到图像的生成方向,Stable Diffusion的研究发现提示词与输出之间存在着显著的组合泛化问题。例如,在输入“红草绿花”的情况下,输出结果可能会是相反,这表明AI模型对于语义的理解存在错误。同样,当输入“一匹马骑着宇航员的照片”时,输出结果可能会是宇航员骑着马的照片,这也暴露出模型在语义理解方面的不足之处。为了解决这些问题,需要进一步研究和优化多模态大模型,研究方向包括改进模型的组合泛化能力、提高模型对于语义的理解、以及优化跨模态生成结果的准确性等,以使得多模态大模型在实际应用中更加可靠和有效。

(以上文图生成来自Stable Diffusion)

03 多模态大模型尚未完全理解多模态数据

GPT4大模型发布,加速了AIGC多模态的发展,当然多模态大模型的发展在近年来取得了令人瞩目的进展,但是作为一项前沿技术,仍存在着一系列问题需要解决。其中一个重要问题就是对于多模态数据的理解还不够充分。多模态数据是指来自不同感官或媒介的数据,如图像、音频、文本等。虽然多模态大模型可以同时处理多种类型的数据,但是对于跨模态数据的融合、对齐等方面,仍需要进一步探索和优化。

首先,对于多模态数据中的事实知识的理解不足。在实际应用中,很多跨模态生成任务都需要丰富的知识库和背景知识支撑。例如,文本描述和图像生成任务需要对具体事物的特征进行深入了解,而涉及到自然语言的任务,则需要对语言语义的理解更加准确。因此,建立更为完整准确的知识库是非常重要的。

其次,常识储备不足也是多模态大模型的瓶颈之一。常识是解决现实问题的基础,而在跨模态生成任务中,常识更是不可或缺。例如,在利用AIGC中AI作画的Stable Diffusion 作图的一个图像描述中,描绘出“小狗在路边玩耍”的情境更加符合日常生活的常识,而非描述为“四条腿的动物在道路上移动”,这说明常识缺失直接影响模型的表现效果。

最后,逻辑推理能力也是多模态大模型需要改进的地方。在实际场景中,有很多跨模态生成任务,需要通过逻辑推理进行相关内容的理解和生成。例如,基于文本的图像生成任务需要根据文本中的描述进行相应的推理,以便生成一张完整的图像。而当前多模态大模型的逻辑推理能力仍有待提高,未来的研究应该注重逻辑推理技术的研究和优化,以提高模型的综合表现能力。

总之,多模态大模型的未来研究应该致力于处理多模态数据的全面理解,选取合适的知识库和常识库,探索逻辑推理技术等方向,以提高多模态大模型在跨模态生成领域的表现效果。

(以上图来自视觉问答VQA)

04 多模态大模型PaLM-E离实用级还有多远?

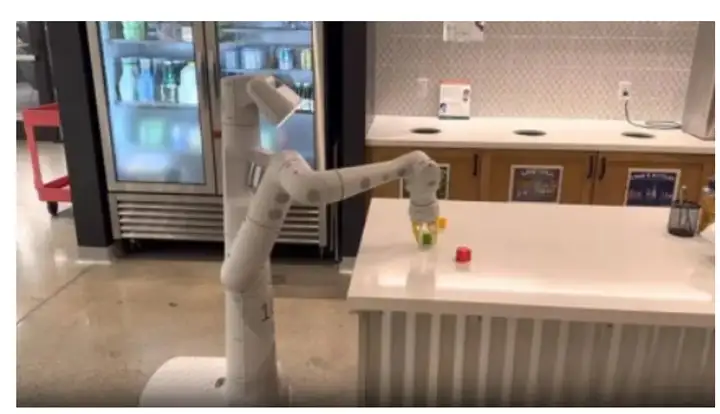

多模态大模型PaLM-E的出现,标志着计算语言学作为人工智能领域的重要分支进入了一个新的繁荣期。PaLM-E依赖于如此庞大的参数,初步实现了对机器人的操控,但其在实用性方面还有待提高。其中,空间范围、物品种类和任务规划复杂度等方面的限制是最为突出的。目前展示出来的演示,其空间范围封闭有限,物品种类数量有限,规划任务比较简单,操作任务也相对简单。这些限制的存在,让人们对PaLM-E在真实复杂场景中的实用价值产生了质疑。

此外,PaLM-E在使用过程中还存在一些技术问题,例如需要耗费大量的时间来调试和训练,同时还需强大的计算资源才能支持其正常运行。这些问题在实际应用中都会给使用者带来极大的不便和成本压力。因此,需要从技术上不断优化和改进PaLM-E,使它能够更好地适应复杂的应用场景,并且让成本更低、易用性更高。当然,尽管PaLM-E离实用级还有一定距离,但是可以相信,随着技术的不断发展和突破,PaLM-E将结合各种场景打破技术限制,真正走进人们的生活和工作中,发挥其巨大的实用价值。

(以上图来自网络)

05 小结:多模态大模型的本质、前提与不足剖析

相比于传统的统计模型,多模态大模型有很多优势。它能够利用多种不同的信息源来进行学习和推理,从而更加全面地捕捉人类的知识、常识和逻辑推理能力;它也能够以较低成本实现自然语言处理、计算机视觉和语音识别等多项任务,提高了模型的效率和普适性;最后,多模态大模型还能够为人类提供更加直观、易懂的交互体验,让人们更加方便地获取信息和进行决策。

然而,多模态大模型也存在一些不足之处。首先,由于不同模态数据之间的差异性,多模态大模型的建立和优化过程需要消耗大量的计算资源和时间。其次,该模型尚存在着一些挑战和难点,例如如何对不同模态数据之间的关联进行建模以及如何解决数据对齐和逆向推导等问题。此外,多模态大模型还需要克服数据质量、隐私保护和数据伦理等方面的挑战,才能更好地应用于实际场景中。

因此,想要在AIGC领域发挥多模态大模型的优势,需要在技术研究、数据质量管理、隐私保护和数据伦理等方面继续深入研究和探索。只有在不断完善和优化多模态大模型的同时,才能更好地应对现实世界中的复杂情境和问题,提高人类社会的智能化水平。

原文链接:https://www.cnblogs.com/huaweiyun/p/17339879.html

本站文章如无特殊说明,均为本站原创,如若转载,请注明出处:AIGC的阿克琉斯之踵 - Python技术站

微信扫一扫

微信扫一扫  支付宝扫一扫

支付宝扫一扫