卷积神经网络

-

机器学习三 卷积神经网络作业

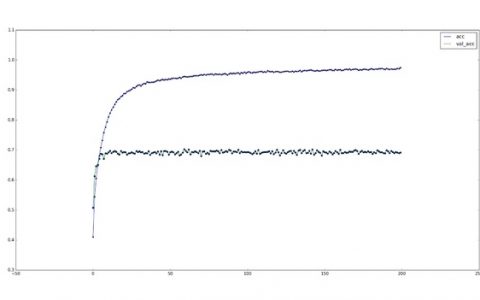

本来这门课程http://speech.ee.ntu.edu.tw/~tlkagk/courses_ML16.html 作业是用卷积神经网络做半监督学习,这个还没完全解决,于是先从基础的开始,用keras 实现cifar10。 以下是代码 1 # -*- coding: utf-8 -*- 2 __author__ = ‘Administrator’ 3 4…

-

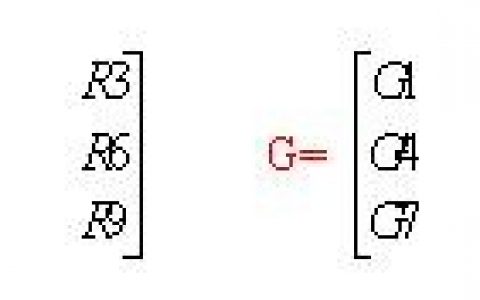

图像处理:基础(模板、卷积运算)

1.使用模板处理图像相关概念: 模板:矩阵方块,其数学含义是一种卷积运算。 卷积运算:可看作是加权求和的过程,使用到的图像区域中的每个像素分别于卷积核(权矩阵)的每个元素对应相 乘,所有乘积之和作为区域中心像素的新值。 卷积核:卷积时使用到的权用一个矩阵表示,该矩阵与使用的图像区域大小相…

-

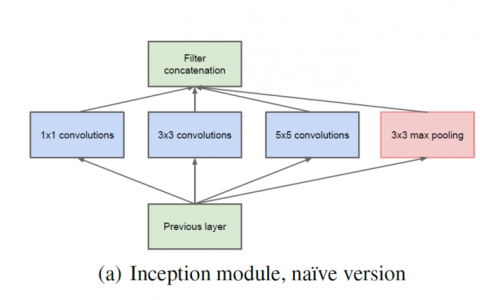

深度卷积网络-Inception系列

主要列举的网络结构有: Inception V1: Going Deeper with Convolutions Inception V2: Batch Normalization: Accelerating Deep Network Training by Reducing Internal Covariate Shift Inception V3: …

-

[winograd]winograd算法在卷积中的应用

在卷积神经网络当中, 卷积运算是尤其是计算敏感的, 尤其是在端上设备中, 对于性能的要求更为苛刻。对于卷积优化的方法也有很多种,本文便针对近年来最常见的优化方法Winograd做一个简单总结。 相关资料 winograd算法最早是1980年由Terry Winograd提出的,当时并没有引起太大的轰动。在CVPR’16会议上,Lavin等人[1]提出了利用w…

-

[转] 1*1卷积核作用

妈蛋不让直接贴内容,那mark个地址吧: https://www.zhihu.com/question/56024942 第二个回答,图文并茂,直击要点。

-

[转] 理解NLP中的卷积&&Pooling

转自:http://blog.csdn.net/malefactor/article/details/51078135 CNN是目前自然语言处理中和RNN并驾齐驱的两种最常见的深度学习模型。图1展示了在NLP任务中使用CNN模型的典型网络结构。一般而言,输入的字或者词用Word Embedding的方式表达,这样本来一维的文本信息输入就转换成了二维的输入结构…

-

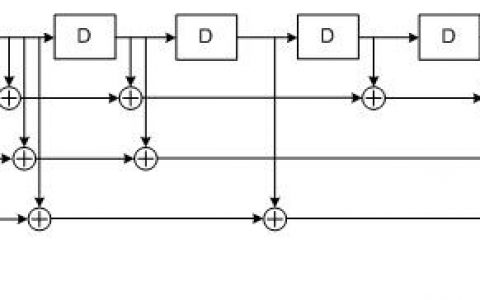

【零基础学会LTE】【3】LTE 36.212 咬尾卷积码详解

//本文均属原创,转载请注明出处。 //本课程以36.212 v10.4.0为教材,请自行到3GPP网站下载。 //由于保密的原因,暂不提供代码查看。 模块作用:对控制信息和广播信道进行信道编码,增强鲁棒性。 相关模块:速率匹配 咬尾卷积码优缺点:克服了码率损失的问题,并且适合迭代译码,但是译码复杂度增加了。 本文主要介绍咬尾卷积码,协议上(v10.…

-

【零基础学会LTE】【4】LTE 36.212 咬尾卷积码译码

//本文均属原创,转载请注明出处。 //本课程以36.212 v10.4.0为教材,请自行到3GPP网站下载。 //由于保密的原因,暂不提供代码查看。 模块作用:对咬尾卷积码进行译码。 相关模块:咬尾卷积码编码,阅读本节之前请阅读编码节。 模块优缺点: 适用范围: 对应章节: 本节主要介绍咬尾卷积码的译码,关于咬尾卷积码的译码方法很多,这里我只介绍最…

-

卷积神经网络–padding

1. 当padding 为VALID时: 输出宽和高的公式代码为: output_width = (input_width – filter_width + 1) / strides_width; (结果向上取整) output_height = (input…

-

集合并卷积

因为小星星那题才知道有这么个东西。。 下面这段从uoj复制的:http://liu-runda.blog.uoj.ac/blog/2360 题目 给出h[0…(2n)−1],满足h[x]=sigma{f[i]*g[j],1<=i<=n,1<=j<=n,i|j==x} 我们记F[i]=sigma(f[j],j&i==j),G[i…

![[转] 理解NLP中的卷积&&Pooling](https://pythonjishu.com/wp-content/uploads/2023/04/HdKZtTNwMMyi20230406.jpg)