PyTorch

-

Pytorch实现波阻抗反演

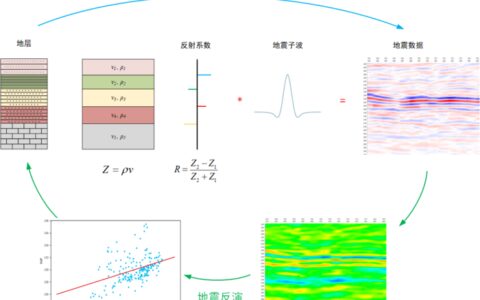

Pytorch实现波阻抗反演 1 引言 地震波阻抗反演是在勘探与开发期间进行储层预测的一项关键技术。地震波阻抗反演可消除子波影响,仅留下反射系数,再通过反射系数计算出能表征地层物性变化的物理参数。常用的有道积分、广义线性反演、稀疏脉冲反演、模拟退火反演等技术。 随着勘探与开发的深入,研究的地质目标已经从大套厚层砂体转向薄层砂体,而利用常规波阻抗反演方法刻画薄…

-

从零搭建Pytorch模型教程(四)编写训练过程–参数解析

前言 训练过程主要是指编写train.py文件,其中包括参数的解析、训练日志的配置、设置随机数种子、classdataset的初始化、网络的初始化、学习率的设置、损失函数的设置、优化方式的设置、tensorboard的配置、训练过程的搭建等。由于篇幅问题,这些内容将分成多篇文章来写。本文介绍参数解析的两种方式。 欢迎关注公众号CV技术指南,专注于计算机…

-

实践torch.fx第一篇——基于Pytorch的模型优化量化神器

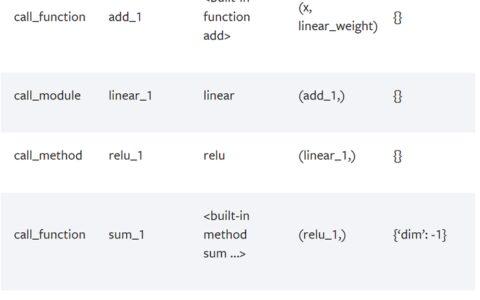

第一篇——什么是torch.fx 今天聊一下比较重要的torch.fx,也趁着这次机会把之前的torch.fx笔记整理下,笔记大概拆成三份,分别对应三篇: 什么是torch.fx 基于torch.fx做量化 基于torch.fx量化部署到TensorRT 本文对应第一篇,主要介绍torch.fx和基本使用方法。废话不多说,直接开始吧! 什么是Torch.FX…

-

【深度学习 论文篇 03-2】Pytorch搭建SSD模型踩坑集锦

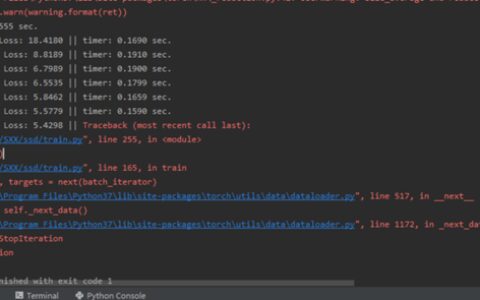

论文地址:https://arxiv.org/abs/1512.02325 源码地址:http://github.com/amdegroot/ssd.pytorch 环境1:torch1.9.0+CPU 环境2:torch1.8.1+cu102、torchvision0.9.1+cu102 1. StopIteration。Batch_size设置32,…

-

【笔记】PyTorch快速入门:基础部分合集

一天时间快速上手PyTorch PyTorch快速入门 Tensors Tensors贯穿PyTorch始终 和多维数组很相似,一个特点是可以硬件加速 Tensors的初始化 有很多方式 直接给值 data = [[1,2],[3,4]] x_data = torch.tensor(data) 从NumPy数组转来 np_arr = np.array(dat…

-

PyTorch全连接ReLU网络

PyTorch全连接ReLU网络 1.PyTorch的核心是两个主要特征: 一个n维张量,类似于numpy,但可以在GPU上运行 搭建和训练神经网络时的自动微分/求导机制 本文将使用全连接的ReLU网络作为运行示例。该网络将有一个单一的隐藏层,并将使用梯度下降训练,通过最小化网络输出和真正结果的欧几里得距离,来拟合随机生成的数据。 2.张量 2.1 热身: …

-

从零搭建Pytorch模型教程(三)搭建Transformer网络

前言 本文介绍了Transformer的基本流程,分块的两种实现方式,Position Emebdding的几种实现方式,Encoder的实现方式,最后分类的两种方式,以及最重要的数据格式的介绍。 本文来自公众号CV技术指南的技术总结系列 欢迎关注公众号CV技术指南,专注于计算机视觉的技术总结、最新技术跟踪、经典论文解读、CV招聘信息。 在讲如何…

-

深度学习训练过程中的学习率衰减策略及pytorch实现

学习率是深度学习中的一个重要超参数,选择合适的学习率能够帮助模型更好地收敛。 本文主要介绍深度学习训练过程中的6种学习率衰减策略以及相应的Pytorch实现。 1. StepLR 按固定的训练epoch数进行学习率衰减。 举例说明: # lr = 0.05 if epoch < 30 # lr = 0.005 if 30 <= epoch <…

-

【深度学习 01】线性回归+PyTorch实现

1. 线性回归 1.1 线性模型 当输入包含d个特征,预测结果表示为: 记x为样本的特征向量,w为权重向量,上式可表示为: 对于含有n个样本的数据集,可用X来表示n个样本的特征集合,其中行代表样本,列代表特征,那么预测值可用矩阵乘法表示为: 给定训练数据特征X和对应的已知标签y,线性回归的⽬标是…

-

Ubuntu下安装pytorch(GPU版)

我这里主要参考了:https://blog.csdn.net/yimingsilence/article/details/79631567 并根据自己在安装中遇到的情况做了一些改动。 先说明一下我的Ubuntu和GPU版本: Ubuntu 16.04 GPU:GEFORCE GTX 1060 1. 查看显卡型号 使用命令:lspci | grep -…