人工智能

-

【语义分割】Stacked Hourglass Networks 以及 PyTorch 实现

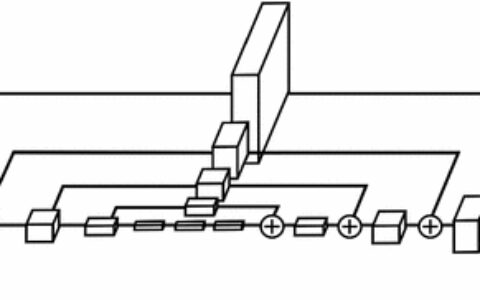

Stacked Hourglass Networks(级联漏斗网络) 姿态估计(Pose Estimation)是 CV 领域一个非常重要的方向,而级联漏斗网络的提出就是为了提升姿态估计的效果,但是其中的经典思想可以扩展到其他方向,比如目标识别方向,代表网络是 CornerNet(预测目标的左上角和右下角点,再进行组合画框)。 CNN 之所以有效,是因为它能…

-

猫狗识别——PyTorch

猫狗识别 数据集下载: 网盘链接:https://pan.baidu.com/s/1SlNAPf3NbgPyf93XluM7Fg 提取密码:hpn4 1. 要导入的包 import os import time import numpy as np import torch import torch.nn as nn import torch…

-

PyTorch 之 Datasets

实现一个定制的 Dataset 类 Dataset 类是 PyTorch 图像数据集中最为重要的一个类,也是 PyTorch 中所有数据集加载类中应该继承的父类。其中,父类的两个私有成员函数必须被重载。 getitem(self, index) # 支持数据集索引的函数 len(self) # 返回数据集的大小 Datasets 的框架: class Cus…

-

[笔记] 将numpy的操作转移到pytorch的tensor上运行可以加速

简单起见,仅实验了矩阵加法及广播操作,其他操作未实验。 目前结论是: 将numpy转为pytorch的tensor,可以加速(0.22s -> 0.12s) 如果将tensor加载到gpu上,能够加速更多(0.22s -> 0.0005s),但是内存与显存的拷贝时间不容忽视 实验过的环境如下,结论都成立: Win10, 64 bit Ubuntu…

-

安装PyTorch 0.4.0

https://blog.csdn.net/sunqiande88/article/details/80085569 https://blog.csdn.net/xiangxianghehe/article/details/80103095

-

pytorch网络转libtorch常见问题

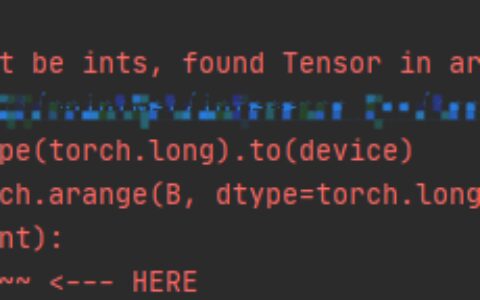

一、All inputs of range must be ints, found Tensor in argument 0: 问题参数类型不正确,函数的默认参数是tensor 解决措施函数传入参数不是tensor需要注明类型我的问题是传入参数npoint是一个int类型,没有注明会报错,更改如下:由 def test(npoint): … 更改为 de…

-

Pytorch训练模型常用操作

One-hot编码 将标签转换为one-hot编码形式 def to_categorical(y, num_classes): “”” 1-hot encodes a tensor “”” new_y = torch.eye(num_classes)[y.cpu().data.numpy(), ] if (y.is_cuda): return new_y.c…

-

pytorch入门1——简单的网络搭建

代码如下: %matplotlib inline import torch import torch.nn as nn import torch.nn.functional as F from torchsummary import summary from torchvision import models class Net(nn.Module): de…

-

tensorflow1.15 keras 自编码 — > Keras上实现AutoEncoder自编码器

参考:Building Autoencoders in Keras[https://blog.keras.io/building-autoencoders-in-keras.html]Keras上实现AutoEncoder自编码器[https://blog.csdn.net/marsjhao/article/details/68928486] 全连接 imp…

-

keras调参经验

调参技巧 层叠LSTM的层时 尽量保持两个隐藏层个数一致 收敛的快的多 两层LSTM比一层好很多 激活函数很重要 relu通常效果比较好 激活函数使用笔记 激活函数介绍 学习率太大(0.02),记得要是0.001数量级的学习率,否则直接不收敛,因此学习率不要太大,越小越好 正则化参数 L1正则化效果很差 L2正则化 一般是0.01左右 这个参数影响不太 而且…